O QUE É A INTELIGÊNCIA ARTIFICIAL E SUA IMPORTÂNCIA NA EVOLUÇÃO HUMANA: DESDE A ANTIGUIDADE,ATÉ OS RISCOS E DILEMAS ÉTICOS

O que é Inteligência Artificial?

Inteligência Artificial (IA) é um ramo da ciência da computação que se propõe a elaborar dispositivos que simulem a capacidade humana de raciocinar, perceber, tomar decisões e resolver problemas, enfim, a capacidade de ser inteligente.

Existente há décadas, esta área da ciência é grandemente impulsionada com o rápido desenvolvimento da informática e da computação, permitindo que novos elementos sejam rapidamente agregados à IA.

História

Iniciada dos anos 1940, a pesquisa em torno desta incipiente ciência eram desenvolvidas apenas para procurar encontrar novas funcionalidades para o computador, ainda em projeto. Com o advento da Segunda Guerra Mundial, surgiu também a necessidade de desenvolver a tecnologia para impulsionar a indústria bélica.

Com o passar do tempo, surgem várias linhas de estudo da IA, uma delas é a biológica, que estuda o desenvolvimento de conceitos que pretendiam imitar as redes neurais humanas. Na verdade, é nos anos 60 em que esta ciência recebe a alcunha de Inteligência Artificial e os pesquisadores da linha biológica acreditavam ser possível máquinas realizarem tarefas humanas complexas, como raciocinar.

Depois de um período negro, os estudos sobre redes neurais volta à tona nos anos 1980, mas é nos anos de 1990 que ela tem um grande impulso, consolidando-a verdadeiramente como a base dos estudos da IA.

Depois de um período negro, os estudos sobre redes neurais volta à tona nos anos 1980, mas é nos anos de 1990 que ela tem um grande impulso, consolidando-a verdadeiramente como a base dos estudos da IA.

IA na vida real

Hoje em dia, são várias as aplicações na vida real da Inteligência Artificial: jogos, programas de computador, aplicativos de segurança para sistemas informacionais, robótica (robôs auxiliares), dispositivos para reconhecimentos de escrita a mão e reconhecimento de voz, programas de diagnósticos médicos e muito mais.

IA na ficção

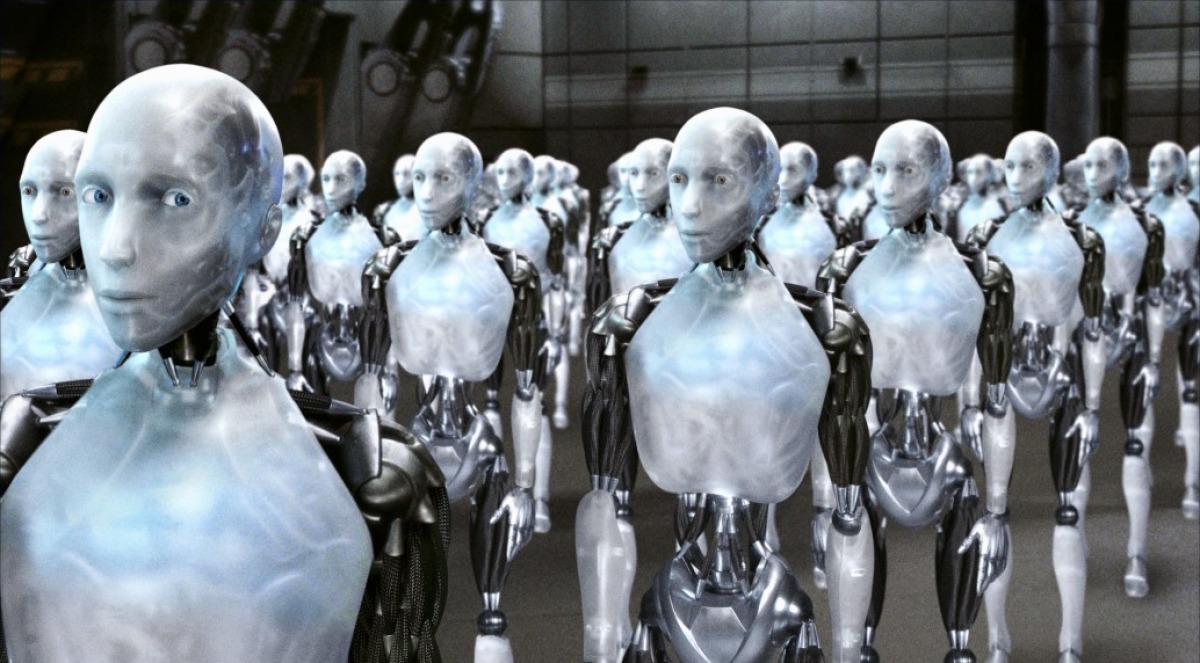

Um tema bastante recorrente em histórias de ficção científica, a Inteligência Artifical está presente em livros, desenhos animados e filmes. Um autor de grande destaque nesta área é o russo Isaac Asimov, autor de histórias de sucesso como O Homem Bicentenário e Eu, Robô. Ambas receberam adaptação para o cinema. Outra história que caiu nas graças do público foi AI: Inteligência Artificial, dirigido por Steven Spielberg.

Porém, nem tudo são flores na visão daqueles que levam a IA para a ficção. Filmes como 2001: Uma Odisséia no Espaço, dirigido por Stanley Kubrick, Matrix, de Andy e Larry Wachowski, e Exterminador do Futuro, dirigido por James Cameron, mostram como a humanidade pode ser subjugada por máquinas que conseguem pensar como o ser humano e ser mais frias e indiferentes a vida do que seus semelhantes de carne e osso.

A controvérsia

Baseando-se em histórias fictícias como as citadas anteriormente, não é difícil imaginar o caos que poderá ser causado por seres de metal, com um enorme poder físico e de raciocínio, agindo independentemente da vontade humana. Guerras desleais, escravidão e até mesmo a extinção da humanidade estão no rol das conseqüências da IA.

Baseando-se em histórias fictícias como as citadas anteriormente, não é difícil imaginar o caos que poderá ser causado por seres de metal, com um enorme poder físico e de raciocínio, agindo independentemente da vontade humana. Guerras desleais, escravidão e até mesmo a extinção da humanidade estão no rol das conseqüências da IA.

Por outro lado, robôs inteligentes podem ser de grande utilidade na medicina, diminuindo o número de erros médicos, na exploração de outros planetas, no resgate de pessoas soterradas por escombros, além de sistemas inteligentes para resolver cálculos e realizar pesquisas que poderão encontrar cura de doenças.

Como pode ser notado, a Inteligência Artificial é um tema complexo e bastante controverso. São diversos os pontos a favor e contra e cada lado tem razão em suas afirmações. Cabe a nós esperar que, independente dos rumos que os estudos sobre IA tomem, eles sejam guiados pela ética e pelo bom senso.

Inteligência

Artificial

O que é e qual sua importância?

A inteligência artificial (IA) possibilita

que máquinas aprendam com experiências, se ajustem a novas entradas de dados e

performem tarefas como seres humanos. A maioria dos exemplos de IA sobre os

quais você ouve falar hoje – de computadores mestres em xadrez a carros

autônomos – dependem de deep learning e processamento de linguagem natural. Com essas

tecnologias, os computadores podem ser treinados para cumprir tarefas

específicas ao processar grandes quantidades de dados e reconhecer padrões

nesses dados.

História da Inteligência Artificial

O termo inteligência artificial foi criado em 1956, mas só se

popularizou hoje graças aos crescentes volumes de dados disponíveis, algoritmos

avançados, e melhorias no poder e no armazenamento computacionais.

As primeiras pesquisas de IA nos anos 1950 exploraram temas como

a resolução de problemas e métodos simbólicos. Na década de 1960, o

Departamento de Defesa dos EUA se interessou por este tipo de tecnologia e

começou a treinar computadores para imitar o raciocínio humano básico. Por

exemplo, a Defense Advanced Research Projects Agency (DARPA) completou um

projeto de mapeamento de ruas nos anos 1970. E a DARPA criou assistentes

pessoais inteligentes em 2003, muito tempo antes de Siri, Alexa ou Cortana

serem nomes comuns do nosso cotidiano.

Esses primeiros trabalhos prepararam o caminho para a automação

e o raciocínio formal que vemos nos computadores de hoje, incluindo sistemas de

apoio à decisão e sistemas inteligentes de pesquisa que podem ser projetados

para complementar e expandir as capacidades humanas.

Enquanto os filmes de Hollywood e os romances de ficção

científica retratam a inteligência artificial como robôs humanoides que dominam

o mundo, a evolução atual das tecnologias de IA não é tão assustadora – ou tão

inteligente assim. Em vez disso, a IA evoluiu para fornecer muitos benefícios

específicos para todas as indústrias. Continue lendo para conhecer exemplos

atuais de inteligência artificial em operadoras de saúde, varejo e mais.

“A IA tem sido uma parte integral dos

softwares SAS há anos. Hoje, nós ajudamos clientes em todas as indústrias a

capitalizarem sobre os avanços em IA, e nós continuaremos a embutir tecnologias

de IA como machine learning e deep learning em todo o portfólio de soluções SAS.”

Jim Goodnight CEO SAS

Qual é a importância da inteligência

artificial?

·

A IA automatiza a aprendizagem repetitiva e a descoberta a

partir dos dados. Mas a inteligência artificial é diferente da automação

robótica guiada por hardwares. Em vez de automatizar tarefas manuais, a IA

realiza tarefas frequentes, volumosas e computadorizadas de modo confiável e

sem fadiga. Para este tipo de automação, a interferência humana ainda é

essencial na configuração do sistema e para fazer as perguntas certas;

·

A IA adiciona inteligência a produtos

existentes. Na maioria dos casos, a inteligência artificial não será vendida

como uma aplicação individual. Pelo contrário, os produtos que você já utiliza

serão aprimorados com funcionalidades de IA, de maneira parecida como a Siri

foi adicionada aos produtos da Apple. Automação, plataformas de conversa, robôs

e aparelhos inteligentes podem ser combinados com grandes quantidades de dados

para aprimorar muitas tecnologias para casa e escritório, de inteligência em

segurança à análise de investimentos;

·

A IA se adapta através de algoritmos de aprendizagem progressiva para deixar que os

dados façam a programação. A IA encontra estruturas e regularidades nos dados

para que o algoritmo adquira uma capacidade: ele se torna um classificador ou

predicador. Então, assim como o algoritmo pode ensinar a si mesmo a jogar

xadrez, ele pode ensinar a si mesmo quais produtos recomendar em seguida. E os

modelos se adaptam quando recebem mais dados. Propagação retroativa é uma

técnica de IA que permite que o modelo se ajuste, através de treinamento e com

a entrada de novos dados, quando a primeira resposta não está totalmente

correta;

·

A IA analisa e mais dados, e em maior profundidade usando redes neurais que

possuem muitas camadas escondidas. Construir um sistema de detecção de fraudes

com cinco camadas escondidas era quase impossível alguns anos atrás. Tudo isso

mudou com um poderio computacional impressionante e big data. Você precisa de muitos dados para

treinar modelos de deep learning porque eles aprendem diretamente com os dados.

Quanto mais dados você puder colocar neles, mais precisos eles se tornam;

·

A IA atinge uma precisão incrível através de redes

neurais profundas – o que antes era impossível. Por exemplo, suas interações

com a Alexa, pesquisas do Google e Google Fotos são todas baseadas em deep

learning – e elas continuam ficando mais precisas conforme as vamos utilizando.

Na área médica, técnicas de IA baseadas em deep learning, classificação de

imagens e reconhecimento de objetos podem agora ser usadas para encontrar

cânceres em ressonâncias com a mesma precisão de radiologistas bem treinados;

·

A IA obtém o máximo dos dados. Quando algoritmos

aprendem sozinhos, os dados em si podem se tornar propriedade intelectual. As

respostas estão nos dados; você só precisa aplicar IA para extraí-las. Uma vez

que o papel dos dados é mais importante do que nunca, eles podem criar uma

vantagem competitiva. Se você possuir dados numa indústria competitiva, e ainda

que todos estiverem colocando técnicas semelhantes em prática, ganha quem tiver

o melhor conjunto de dados.

O que é

inteligência artificial?

Saiba o que é inteligência artificial e como ela se manifesta na nossa

rotina e qual é o futuro dessa tecnologia

A Inteligência Artificial, que você vai ver por aí

sendo citada apenas como IA (ou AI, de artificial intelligence) é um avanço tecnológico que permite que sistemas simulem uma

inteligência similar à humana — indo além da programação de ordens específicas

para tomar decisões de forma autônoma, baseadas em padrões de enormes bancos de

dados.

Algo tão complicado é também é um campo de estudo acadêmico — que não começou ontem. Há algumas décadas, se estuda o que se chamou de "agentes inteligentes", que percebem seu ambiente, entendem como podem operar e qual a melhor forma. Credita-se ao professor John McCarthy o uso do termo pela primeira vez em 1956, em uma conferência de especialistas em Darmouth Colege, chamada "O Eros Eletrónico", que definiu como "a ciência e a engenharia de produzir máquinas inteligentes".

Como assim, máquinas inteligentes?

A Inteligência Artificial, em sua essência, permite que os sistemas tomem decisões de forma independente, precisa e apoiada em dados digitais. O que, numa visão otimista, multiplica a capacidade racional do ser humano de resolver problemas práticos, simular situações, pensar em respostas ou, de forma mais ampla, potencializa a capacidade de ser inteligente.

Uma nova onda de inovação

Os economistas chamam isso de a quarta revolução industrial, marcada pela convergência de tecnologias digitais, físicas e biológicas — bagunçando as fronteiras das três áreas. E IA faz parte dessa próxima onda de inovação, trazendo grandes mudanças na maneira como pessoas e empresas se relacionam com tecnologia, compartilham dados e tomam decisões.

O que é a inteligência artificial?

Podemos definir inteligência artificial, no grosso modo, como a capacidade das máquinas de pensarem como seres humanos: aprender, perceber e decidir quais caminhos seguir, de forma racional, diante de determinadas situações. Até então, os computadores precisavam de três grandes pilares evoluir da computação simples para a atual, de inteligência artificial:

- Bons modelos de dados para classificar, processar e analisar;

- Acesso a grande quantidade de dados não processados;

- Computação potente com custo acessível para processamento rápido e eficiente.

Com a evolução desses três segmentos, a inteligência artificial tornou-se finalmente possível com a fórmula: big data + computação em nuvem + bons modelos de dados.

Podemos dizer que a IA aprende como uma criança. Aos poucos, o sistema (a depender do objetivo para o qual ele foi criado) absorve, analisa e organiza os dados de forma a entender e identificar o que são objetos, pessoas, padrões e reações de todos os tipos.

Ensinar os computadores a pensar, porém, não é tão simples. A Salesforce detalha que a questão passa por várias áreas da ciência da computação como Machine Learning, Deep Learning e Processamento de Linguagem Natural. "Todos esses termos juntos compõem tudo o que é a inteligência artificial e apontam para um futuro em que nossas plataformas e sistemas terão inteligência suficiente para aprender", explica.

Então vamos às definições:

Machine Learning:

Em vez de programar regras para uma máquina e esperar o resultado, conseguimos deixar que a máquina aprenda essas regras por conta própria a partir dos dados, chegando ao resultado de forma autônoma. As recomendações personalizadas na Netflix e na Amazon, por exemplo, indicam os títulos de acordo com o que o usuário assiste. Conforme você inclui dados (assiste) o sistema aprende o que você gosta.

Em vez de programar regras para uma máquina e esperar o resultado, conseguimos deixar que a máquina aprenda essas regras por conta própria a partir dos dados, chegando ao resultado de forma autônoma. As recomendações personalizadas na Netflix e na Amazon, por exemplo, indicam os títulos de acordo com o que o usuário assiste. Conforme você inclui dados (assiste) o sistema aprende o que você gosta.

Deep Learning:

Quando falamos de aprendizado profundo, estamos nos referindo à uma parte do aprendizado de máquina que utiliza algoritmos complexos para "imitar a rede neural do cérebro humano" e aprender uma área do conhecimento com pouco ou sem supervisão. O sistema pode aprender como se defender de ataques, sozinho.

Quando falamos de aprendizado profundo, estamos nos referindo à uma parte do aprendizado de máquina que utiliza algoritmos complexos para "imitar a rede neural do cérebro humano" e aprender uma área do conhecimento com pouco ou sem supervisão. O sistema pode aprender como se defender de ataques, sozinho.

Processamento de Linguagem Natural:

Esse processamento utiliza as técnicas de machine learning para encontrar padrões em grandes conjuntos de dados puros e reconhecer a linguagem natural. Assim, um dos exemplos de aplicação do PLN é a análise de sentimentos, onde os algoritmos podem procurar padrões em postagens de redes sociais para compreender como os clientes se sentem em relação a marcas e produtos específicos.

Esse processamento utiliza as técnicas de machine learning para encontrar padrões em grandes conjuntos de dados puros e reconhecer a linguagem natural. Assim, um dos exemplos de aplicação do PLN é a análise de sentimentos, onde os algoritmos podem procurar padrões em postagens de redes sociais para compreender como os clientes se sentem em relação a marcas e produtos específicos.

Onde podemos encontrar inteligência artificial?

A IA está por todos os lugares, no carro autônomo, no chão de fábrica e no sistema de atendimento dos hospitais. Mas também está na rede social, no seu celular, no antivírus, no buscador de internet. O Google, por exemplo, é um exemplo de empresa AI-first. Ou seja, todos os seus produtos têm processos de machine learning.

No Google Fotos, é possível procurar por objetos e situações específicos, de “abraços” a “cachorros” e "cores". Além disso, o Assistente está sempre sugerindo criar um GIF, montagem ou efeito.

No Gmail, o e-mail da gigante de buscas, o machine learning ajudou a aprimorar o filtro de spam e, no Google Tradutor, a mudança para o sistema de tradução com máquinas neurais melhorou a qualidade do que era traduzido de forma significativa. Na busca, está o RankBrain, algoritmo que usa deep learning para melhorar o ranqueamento dos links. O reconhecimento de voz no Android também é "aprendizado de máquina".

No Facebook, a tecnologia ajuda a remover conteúdo impróprio antes mesmo de um post ser denunciado por um usuário. Um mix de inteligência artificial, machine learning e visão computacional permite remover conteúdos impróprios com mais rapidez, rastrear mais conteúdo e aumentar a capacidade da equipe de revisão formada por revisores humanos.

Mas, nem tudo são flores: você deve estar se perguntando por que, no caso da rede social, isso "não funciona". O Facebook aponta que a IA é muito promissora, mas ainda está longe de ser eficaz para todos os tipos de conteúdos impróprios, dado que o contexto é algo muito importante. Por isso, ainda temos pessoas revisando denúncias. Nesse caso, a tecnologia é usada para expandir a capacidade e acelerar o processo, mas ainda não substitui pessoas.

A tecnologia precisa de grandes quantidades de dados para ser treinada para reconhecer padrões significativos de comportamento humano. Muitas vezes, alguns idiomas não dispões de todos esses dados ou em algumas regiões os casos não são tão denunciados. É por isso que, normalmente, há mais avanços em inglês, por ser o maior conjunto de dados.

Até no antivírus do seu computador possivelmente há uma combinação similar, com a fusão de três elementos: big data, aprendizado de máquina e análise de especialistas. De acordo com a Kaspersky, uma das funções da KSN (seu serviço de segurança em nuvem) é bloquear as ameaças mais recentes baseada em IA. Ao mesmo tempo, permite a cada usuário participar enviar metadados sobre ameaças novas. Cada informação detectada é adicionada ao banco de dados. E, feito isso, os sistemas podem detectar precisamente não apenas aquela ameaça, mas também outras com construções similares.

O funcionamento da IA envolve muito mais do que perceber a presença dela nas suas experiências diárias. Toda vez que você pega seu smartphone, já está vendo o que a IA pode fazer por você. Mas, por trás de cada recomendação personalizada, até resultados de pesquisa relevantes, existe uma combinação de tecnologias que faz a inteligência artificial funcionar e que está, por consequência, fazendo com que você tenha expectativas mais altas sobre todas as máquinas inteligentes e dispositivos que usa.

Um caminho sem volta.

A IA vai roubar o seu emprego?

O futuro da IA aponta e urge para uma tecnologia cada vez mais transparente, eticamente construída e que faz parte de tarefas do dia a dia, no trabalho ou na nossa vida pessoal, aumentando nossas capacidades cognitivas. A IA pode tornar o ser humano mais produtivo, liberando profissionais de determinadas tarefas mecânicas e repetitivas para que possam usar o máximo de sua capacidade para criar e inovar em outros setores. Uma mudança no mercado de trabalho foi iniciada e, certamente, isso vai ceifar algumas vagas no futuro.

Mas falando em uma visão otimista, Alessandro Jannuzzi, diretor de engenharia e inovação na Microsoft Brasil, afirma que a companhia assumiu o compromisso de democratizar o acesso à IA. "Estamos buscando na IA os recursos necessários para ajudar a resolver os problemas mais urgentes da nossa sociedade. Nesse sentido, a nossa abordagem é dividida em três pilares: liderar inovações que ampliam a capacidade humana; construir poderosas plataformas que tornam a inovação mais rápida e acessível; e desenvolver uma abordagem confiável que coloque o cliente no controle e proteja seus dados", explicou.

Vale notar que, no mundo dos negócios, é bom lembrar que se você não está sendo disruptivo no seu setor, certamente alguém está. E a IA pode ser a maior aliada para contribuir com esse tipo de transformação digital que as empresas tanto buscam. Combinada com a capacidade humana, pode impulsionar pessoas a fazerem coisas incríveis.

A inteligência artificial é mais antiga do que você

imagina

"Será que um escravo, em posse de informações inatas, poderia

aprender matemática?", pensavam os filósofos

Não é de hoje que abordamos ferramentas

de inteligência artificial no Tecnoblog. Vemos o

Google aproveitando a tecnologia para vencer campeões mundiais de jogos de tabuleiro complexos e

até combater o Aedes

aegypti. A Microsoft já sinalizou vários investimentos na área,

seja com "capacidade humana" ou nos aplicativos da Microsoft Research.

O que

pouca gente sabe é que ela é uma das novidades mais... antigas, sendo

idealizada em tempos até antes de Cristo. A inteligência

artificial, ainda que muito mais palpável nos dias

de hoje, vem até dos filósofos gregos e teve um grande avanço também no

século XX. Para falar sobre o assunto, entrevistamos João Fernando Marar,

professor doutor de Inteligência Artificial na Universidade Estadual Paulista

(Unesp).

Para

entender o que exatamente é esse termo, precisamos recorrer à origem da

inteligência artificial. Ela é uma área da ciência da computação na qual os

pesquisadores buscavam realidades diferentes de um modelo simplesmente

programático. Não para resolver problemas simples, como adição de dois números,

mas para criar uma espécie de pensamento na

computação.

A área é dividida em duas

partes: inteligência artificial simbólica, que é ligada à psicologia;

e a de conexionismo,

ou redes neurais artificiais, que vem da neurofisiologia. Essa última, para

referência, foi a que o Google mencionou quando explicou como funciona o AlphaGo,

robô de IA da DeepMind treinado para jogar Go.

Segundo

Fernando, a ciência da computação é uma área de estudo recente, mas não a

inteligência artificial. "Ela vem lá dos filósofos gregos, do Platão, do

Aristóteles. É muito interessante observar esses estudiosos do passado. Eles

vão remontando e construindo o que nós entendemos hoje como um modelo

científico", afirma. "Aí você pensa 'pô, mas um cara lá em 300 a.C.

já pensava à frente do nosso tempo?'. Sem dúvida", diz.

A inteligência artificial na antiguidade

Não que

já existissem sistemas que faziam coisas por si próprios, mas a ideia de uma

inteligência não humana que pensasse por si própria já era idealizada, segundo

o professor. Ele diz que Aristóteles, professor de Alexandre, o Grande, rei da

Macedônia (na Grécia Antiga), pensava em como livrar o escravo dos seus

afazeres.

"O escravo era tratado como um

nada no aspecto social. Ele imaginava o seguinte: será que um objeto como uma

vassoura, ou seja, um elemento que faz a limpeza, pode ter vontade própria

e estabelecer o sistema de arrumação? Dessa forma, não precisaríamos mais da

mão de obra escrava", explica o professor. "Esses caras viam que não

era legal ter esse domínio e sacrifício de outro ser humano. Ele inventou a

robótica em 300 a.C!", completa.

"Ele inventou a robótica em 300

a.C."

Ele explica que os filósofos se perguntavam coisas como: "será que

um escravo, em posse de informações inatas (que já vêm com a natureza do

homem), poderia aprender matemática?". É claro que sim. O revolucionário

está na linha de pensamento, pois eles já idealizavam a ciência cognitiva, que

trata da aprendizagem humana.

Desenvolvimento da ciência

A década de 50 pode ser considerada a época dos anos dourados da

inteligência artificial. Havia uma corrente psicológica chamada de

"behavioristas", que tratavam a ciência somente como ato do

comportamento humano: sua mão gira segurando uma maçaneta porque você quer

abrir a porta, por exemplo. Segundo o doutor, essa não é uma boa

explicação. "Eu tenho que ter processamento de informação, que é o

que a ciência cognitiva faz", conta.

"Não é só uma caixa de entrada, um input e um output. Eu quero saber o que tem aqui

dentro [da caixa]. É o que a inteligência artificial estuda, saber o que tem

dentro dessa grande caixa. A inteligência artificial se ramifica em muitas

áreas, de games à filosofia. No fundo, podemos imaginar essa ciência como uma

grande capilaridade, que pode ser aplicada basicamente em tudo", explica.

O principal, então, é entender que a inteligência artificial é uma só,

mas sua capilaridade é gigantesca. Fernando trabalha nessa área há 40 anos,

passando desde música e computação (na década de 90!) até uma descrição

homodinâmica do funcionamento do coração junto com o pulmão, em 1983 (!).

Segundo ele, esse conceito de inteligência artificial vem sendo muito bem

elaborado há vários anos.

O que conhecemos hoje como inteligência

artificial foi detalhado em um congresso pelo professor John McCarthy, da Universidade

Stanford. Ele começou a usar o termo na conferência que fez na Faculdade de

Dartmouth, em New Hampshire.

Na

época, já existiam várias teorias de complexidade, simulação de linguagem,

redes neurais e máquinas de aprendizagem. Ele resolveu dar o nome de

inteligência artificial para esses sistemas de imaginação humana que usam a

ciência da computação. Vários engenheiros, matemáticos, psicólogos e neurocientistas

participaram.

A

capacidade e a funcionalidade eletrônica dobravam a cada 18 meses, um

crescimento quase exponencial que praticamente não parava de subir. Os

participantes do congresso saíram de lá crentes que, um dia, os computadores

conseguiriam ser tão inteligente quanto os humanos. Bom, ainda não aconteceu.

Mesmo

assim, McCarthy conseguiu grandes avanços em seu laboratório, um dos primeiros

dedicados ao desenvolvimento da inteligência artificial. Ele ganhou o prêmio Turing em 1971, dado a cientistas de

computação que fizeram grandes e duradoras contribuições para a

área. Fernando ressalta que esse prêmio é basicamente o Nobel da

ciência da computação.

Teste de Turing

O nome vem do matemático Alan Turing,

retratado no filme Jogo

da Imitação. Turing também é um dos percursores da área de

inteligência artificial, segundo Fernando, pois o matemático trabalhava

com complexidade. Turing foi responsável por acelerar o processo de quebra

do código da máquina Enigma, para entender como os alemães se comunicavam

durante a Segunda Guerra Mundial.

Outro trabalho

muito interessante, que também veio dele, foi o teste de Turing. Você

fica de frente à um teletipo e não sabe o que conversa com você, se é um

homem ou uma máquina. Se ao final da conversa você não conseguir saber

identificar se é homem ou é máquina, o robô passou no teste de Turing.

Em

2014, um grupo de pesquisadores russos criou o Eugene Goostman, um robô que

representa um garoto de 13 anos que mal fala inglês. Ele enganou os juízes e

acabou ganhando Prêmio Loebner, que é dado para quem passa no teste de

Turing.

Mas o

professor se demonstrou cético em relação aos avanços dos pesquisadores russos.

"Em vez deles fazerem um teste de Turing de alto nível, eles criaram o

teste em baixo nível. É um garoto da Ucrânia que fala mal em inglês e o teste

está sendo feito em inglês. Quando ele enrosca no processo, ele diz que é só

uma criança de 13 anos e não pode responder muito bem", explica.

Em outras palavras, é fácil enganar os

juízes quando você reduz o parâmetro do que o robô pode fazer. "O bacana é

colocar isso ao máximo", diz Fernando. "Não dá pra reduzir a

complexidade do problema. Eu vou enganar as pessoas ali. Vai passar no teste de

Turing, com uma limitação. Mas a limitação é dos russos, e não da inteligência.

O que a gente quer é muito acima", completa.

O teste

de Turing tem usos até hoje. Segundo o doutor, ele deve ter servido de

inspiração para a Microsoft fazer o Bot Framework, por exemplo. "Tudo recai no núcleo

central, o teste de Turing. Como ele faz para alcançar isso, ele poderia usar

tecnologias baseadas em sistemas psicológicos, ou redes neurais artificiais. As

redes neurais artificiais são máquinas de reconhecimento, que verificam se

aquilo passa pelo que a máquina aprendeu", diz.

Estima-se

que somente daqui a 20 anos uma máquina vai conseguir enganar o homem. Quando

perguntado se o Bot Framework da Microsoft poderia passar no teste de Turing,

ele demonstra descrença. "Não necessariamente. Ainda mais aprendendo esse

jeito, perguntando para um humano quando ele não souber", esclarece.

Fernando ainda vangloria as conquistas do

matemático. "O Turing foi tão maravilhoso que ele criou alguns games que

revolucionaram o mundo. A máquina de Turing que ele criou com 24 anos diz que,

se um processo passa por ela, ele passará por qualquer computador que exista ou

existirá", afirma.

Sempre

vemos avanços interessantes na inteligência artificial, mas o especialista vê

tudo isso mais como propaganda. "Isso que os caras estão fazendo são de

tecnologias que o homem conhece e já desenvolveu desde 1943. O teste de Turing

é de 1950. Olhando para o século XX, a metade do século para trás teve os

melhores cientistas que o universo conhecido sabe da existência. Daqui pra

frente, não podemos falar nada", garante.

Dilemas éticos da inteligência artificial

Já que

todo esse trabalho está em desenvolvimento há tanto tempo, perguntei a ele

sobre os dilemas éticos que os computadores podem enfrentar. Já falamos sobre

isso com as questões que um professor da Stanford está

fazendo. O assunto é tão importante que foi tema do Tecnocast 033,

intitulado Programados

para matar.

Imagine

que há um acidente que o carro não pode evitar, como um grupo de pedestres

(incluindo uma mãe com um carrinho de bebê) que atravessou no sinal vermelho em

uma pista de velocidade relativamente alta. O carro não consegue frear a tempo,

então o que ele deve fazer? Atingir o menor objeto, que pode ser um carrinho de

bebê ou de supermercado? Fazer uma curva brusca e arriscar a vida do motorista?

A vida de quem deve ser priorizada: do motorista ou dos pedestres?

sses dilemas com certeza já passaram na

cabeça dos motoristas, que tomaram a decisão "no calor do

momento". Caso aconteça alguma tragédia, é possível até que o

motorista não seja condenado porque talvez ele não tenha tido tempo o

suficiente para pensar na decisão mais adequada. Com os carros autônomos, a

desculpa não funciona.

Perguntei

a Fernando como proceder nesses casos. Ele comparou o caso à falta de leitos na

UTI. Os pacientes só vão à UTI se estiverem em estado gravíssimo; e se não

houver leitos a pessoa praticamente teve a morte declarada. "Eu não tenho

um caso pior para desligar alguém da UTI e colocar outro. É a mesma proporção.

Eu tenho que diminuir os casos de UTI para que sempre sobrem leitos, para o

gargalo nunca quebrar", explica.

"Inteligência artificial também

pode ter patologias"

Ele diz que temos que definir o que é

razão no carro. "Máquinas suficientemente capazes de proceder com a razão.

Se eu chego nesse dilema, de matar um ou outro, não estamos trabalhando com o

lado emocional", esclarece. "Se a gente admite que o ser humano pode

esquecer e ter patologias, como o Alzheimer, vamos ter que admitir que

inteligências também têm esse tipo de patologia".

O

professor ainda menciona os nanotubos de carbono, estruturas que chegam

próximas da nossa própria biologia e podem ser o futuro dos núcleos dos

computadores. Ele critica o medo de que uma máquina pode superar os humanos e

diz que a humanidade não necessariamente precisa ser uma referência para a

inteligência artificial.

"Outros

seres que não possuem neurônios, como amebas, bactérias, também podem ter

inteligência artificial. Eu trabalho com um modelo que é a linguagem de

bactérias. Bactérias conversam umas com as outras, pelo quorum sensing. Mudando

essa visão de paradigma, nós temos outras interpretações para o modelo de cura

humana", explica.

Fernando

também compara o modelo de neurônios com os líquens, uma associação entre um

fungo e uma alga ou cianobactéria. "São seres inteligentes que vão se

conectando uns aos outros e formam uma inteligência coletiva, eles são

inteligentes como um grupo. Como um neurônio, um sozinho não é inteligente, mas

100 bilhões são", diz.

Um perigo para a humanidade?

Em

2014, Stephen Hawking afirmou que a inteligência artificial pode “acabar

com a humanidade”. O físico disse que, conforme o sistema vai ficando mais

inteligente, podemos entrar em perigo.

O

professor não tem essa preocupação. Ele comparou essa questão com a

AIDS. "Você acha que o vírus da AIDS entra no seu sistema imunológico

e já te mata? Não, porque se você morrer ele morre junto. Pensa comigo: os

modelos também são inteligentes. Se o vírus vai sobreviver nesse novo ambiente,

e ele só sobrevive se você também tiver vivo, só um estúpido mataria o seu

hospedeiro", questiona.

Ele não

vê pertinência nessas questões de que a inteligência artificial pode colocar a

raça humana em risco. "A gente tem que abrir mais a mente. Se eu pensar

apenas pelo lado negativo, eu só construo coisas negativas", defende.

Fernando prefere pensar que dá para melhorar inúmeros problemas da humanidade

com a inteligência artificial, como suas contribuições na medicina.

"A

gente ainda pensa as evoluções da ciência e da tecnologia como vilãs dentro da

sociedade, algo violento, porque a gente só consegue pensar em violência.

Quando a gente é treinado para pensar em equilíbrio, felicidade, leveza, vamos

construir os mesmos paradigmas pensando em coisas boas", explica.

Comentários

Postar um comentário